Agence Computer Vision

Vos opérateurs inspectent encore à l'œil nu ?

On automatise ce que l'humain ne peut pas scaler

Contrôle qualité manuel, tri de documents à la main, caméras qui enregistrent sans analyser ? Nous déployons des modèles de vision par ordinateur en production — détection d'objets, OCR, segmentation — avec des pipelines d'annotation, d'entraînement et de monitoring intégrés.

Ils nous font confiance — 250+ projets livrés

Nos technologies Computer Vision

Python et PyTorch comme fondation, YOLO et Segment Anything pour la détection et la segmentation, OpenCV pour le traitement d'images, TensorRT et ONNX pour l'optimisation edge, Roboflow et Label Studio pour l'annotation — le tout déployé sur GPU cloud (AWS, GCP) ou embarqué (NVIDIA Jetson).

Python

Python PyTorch

PyTorch TensorFlow

TensorFlow OpenCV

OpenCV YOLO

YOLO Hugging Face

Hugging Face NVIDIA TensorRT

NVIDIA TensorRT ONNX Runtime

ONNX Runtime Roboflow

Roboflow Label Studio

Label Studio AWS

AWS Google Cloud

Google Cloud FastAPI

FastAPI Docker

Docker+20 technologies computer vision maîtrisées

Nos cas clients en computer vision

Voir tous les cas clients ›

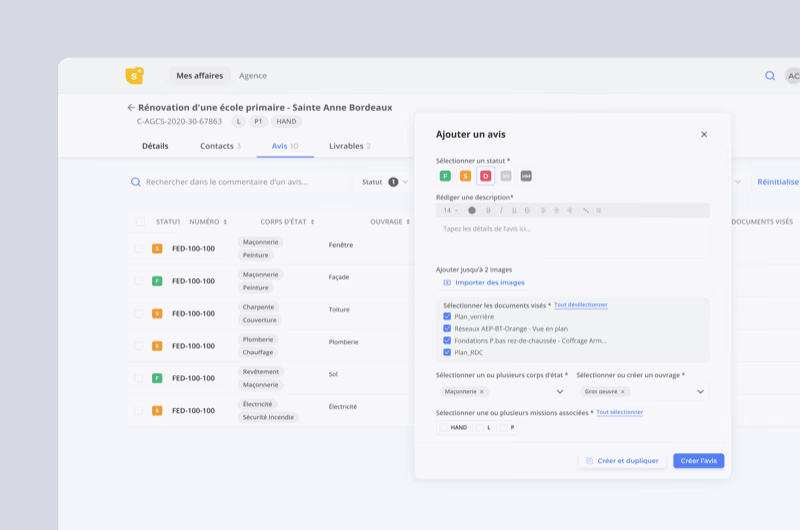

BTP Consultants

Automatisation du traitement de documents techniques par OCR et classification d'images — suppression de la saisie manuelle et réduction de 95 % des coûts d'exploitation.

Voir le cas client ›

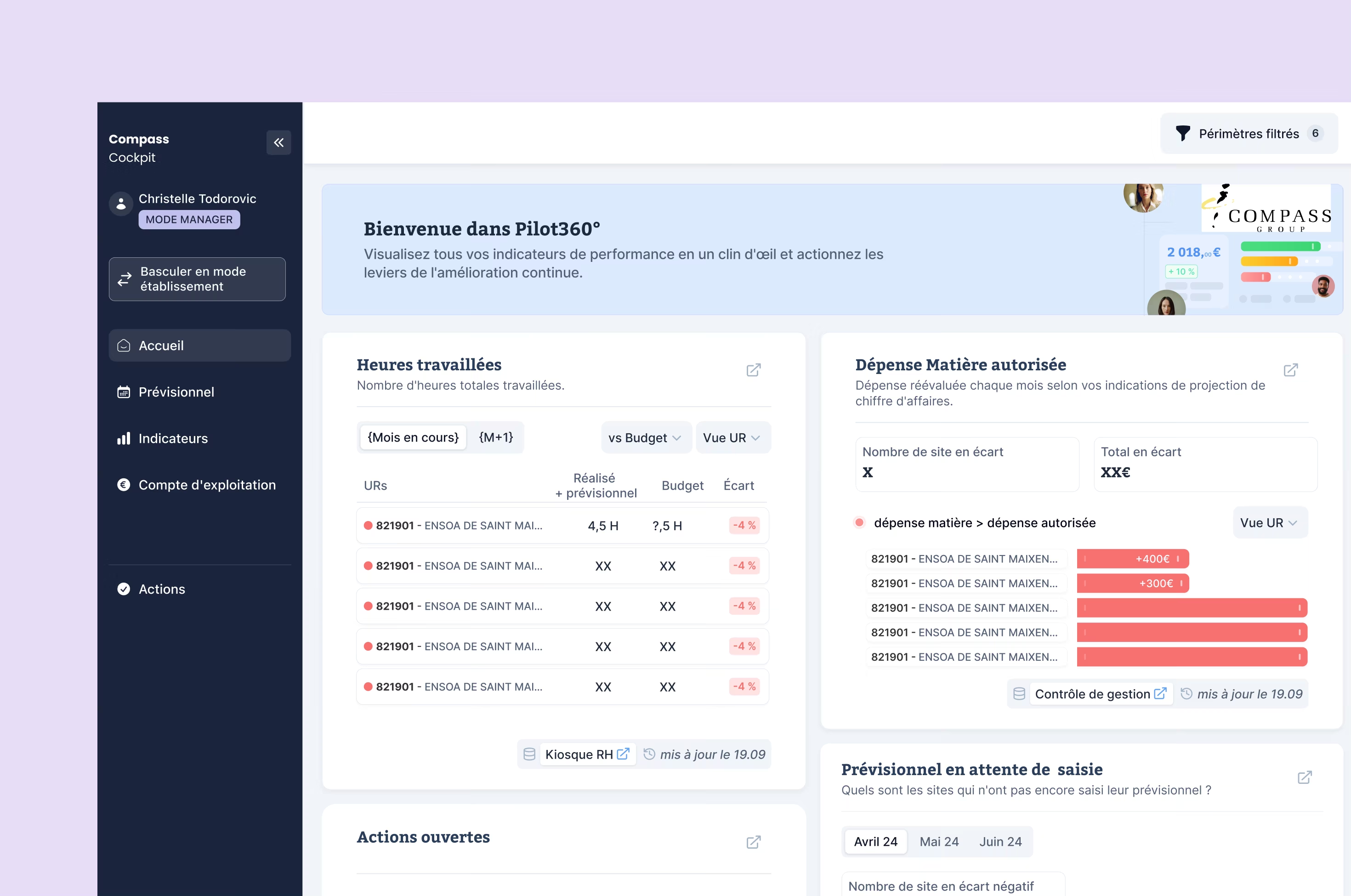

Compass Group

Traitement intelligent de la data visuelle et opérationnelle pour un leader mondial de la restauration collective — 3 000 établissements, 500 000 collaborateurs.

Voir le cas client ›96% de nos clients continuent avec nous

“Ils ont eu énormément d’impact sur le traitement de la data.”

Julien GOUPIT, Directeur Innovation

Des modèles qui tournent en prod, pas des notebooks Jupyter

90 % des POC computer vision ne passent jamais en production. Le modèle marche en labo, mais plante dès qu'il voit des images du terrain — éclairage différent, angles imprévus, classes rares.

Nos ingénieurs vision viennent de l'industrie et du terrain. Ils savent constituer un dataset représentatif, gérer le domain gap entre labo et production, optimiser un modèle pour l'edge (TensorRT, ONNX) et monitorer le drift visuel une fois déployé. Chaque modèle livré est testé sur vos conditions réelles, pas sur ImageNet.

Discutons de votre projet computer vision →Notre approche computer vision en 5 phases

Cadrage & Audit du dataset

Analyse de vos images/vidéos existantes, évaluation de la faisabilité, définition du niveau d'annotation nécessaire et identification des conditions terrain (éclairage, angles, variabilité).

1 à 2 semainesAnnotation & POC

Mise en place du pipeline d'annotation (Roboflow/Label Studio), constitution du dataset de référence, entraînement du premier modèle et validation sur vos images terrain — pas sur des benchmarks académiques.

2 à 4 semainesEntraînement & Optimisation

Fine-tuning du modèle sur votre domaine, data augmentation ciblée, optimisation pour la cible de déploiement (cloud, edge, embarqué). Métriques de production : précision, recall, latence, throughput.

4 à 8 semainesDéploiement & Intégration

Mise en production : API d'inférence scalable ou déploiement edge, intégration dans votre chaîne métier (ERP, MES, SCADA), tests en conditions réelles et validation utilisateur.

2 à 3 semainesMonitoring & Réentraînement

Surveillance du drift visuel, collecte des cas difficiles (hard examples mining), réentraînement incrémental planifié et ajout de nouvelles classes selon l'évolution de vos besoins.

Les problèmes vision concrets que nous résolvons

Vous reconnaissez ces situations ? Ce sont les cas les plus fréquents sur lesquels interviennent nos ingénieurs vision — avec des modèles en production, pas en démo.

Le contrôle qualité repose sur l'œil humain

vos opérateurs inspectent des pièces à la main, ratent les défauts subtils et fatiguent en fin de poste ? Nous déployons de la détection d'anomalies visuelles (YOLO, segmentation sémantique) capable d'inspecter chaque pièce en temps réel — même les défauts de 0,5 mm — avec un taux de rappel supérieur à 99 %.

Vos documents sont triés et saisis à la main

factures, plans techniques, formulaires scannés empilés dans des dossiers ? Nous combinons OCR intelligent (reconnaissance de caractères) et classification de documents pour extraire automatiquement les données structurées, les router vers le bon workflow et supprimer la saisie manuelle.

Vos caméras enregistrent sans rien analyser

des centaines d'heures de vidéo inexploitées, relues manuellement après incident ? Nous déployons de la détection d'objets et du tracking temps réel sur vos flux vidéo — comptage de personnes, détection d'intrusion, analyse de flux, alertes automatiques — directement sur l'edge ou dans le cloud.

Votre POC vision ne passe pas en production

le modèle marche sur le dataset de test mais échoue sur le terrain (éclairage, angles, classes rares) ? Nous reprenons le pipeline de bout en bout : audit du dataset, gestion du domain gap, data augmentation ciblée, optimisation pour l'edge (TensorRT, ONNX, quantization) et monitoring du drift visuel post-déploiement.

Vivez enfin une expérience client 5✦ sans risque et garantie

La croissance fulgurante d’une agence de développement web & mobile autofinancée

Voir la parution ›

Interview de Cyrille ADAM, Co-fondateur de Yield Studio, sur le développement de l’agence

Voir la parution ›

Si l’App Store a trop de concurrents, les utilisateurs risquent de se perdre

Voir la parution ›

Développement logiciel : les entreprises sont à la ramasse et ça coûte (très) cher

Voir la parution ›

Le pari réussi des développeurs séniors à l’ère de l’IA

Voir la parution ›

L’IA contraint les équipes tech à se réorganiser, et c’est une opportunité

Voir la parution ›Découvrez nos articles sur la thématique IA & Vision

Voir tous nos articles ›Nos expertises en Computer Vision

Audit & Dataset — la donnée avant le modèle

Cadrage & Faisabilité — analyse de vos images/vidéos existantes, évaluation de la qualité et du volume du dataset, identification du bon niveau d'annotation (bounding box, segmentation, keypoints). Pipeline d'annotation — mise en place de Roboflow ou Label Studio avec guidelines d'annotation, contrôle qualité inter-annotateurs (Cohen's Kappa) et versioning du dataset. Data augmentation — stratégie d'augmentation adaptée à votre domaine (rotations, éclairage, bruit, mixup, cutout) pour maximiser la performance avec un volume limité d'images.

Entraînement & Optimisation — du modèle au déploiement

Architecture & Transfer learning — choix du backbone adapté (YOLO, EfficientNet, ViT, Segment Anything) et fine-tuning sur vos données métier plutôt qu'entraînement from scratch. Optimisation edge — quantization (INT8, FP16), distillation de modèle, export ONNX/TensorRT pour du temps réel sur GPU embarqué (Jetson), serveur ou cloud. Pipeline MLOps — entraînement reproductible, versioning des modèles et des datasets, A/B testing en production et rollback automatique si les métriques dérivent.

Déploiement & Monitoring — garder la précision dans le temps

Inférence en production — API de prédiction scalable (FastAPI + Triton Inference Server), traitement batch ou temps réel selon le SLA, edge computing pour les sites sans connectivité fiable. Monitoring du drift visuel — surveillance continue de la distribution des prédictions, détection des classes émergentes et des changements de conditions (éclairage saisonnier, usure caméra).

Boucle de réentraînement — collecte automatique des cas difficiles (hard examples mining), réannotation assistée et réentraînement incrémental pour maintenir la précision au fil du temps.

Nos experts à votre service

Questions fréquentes

Ça dépend de la tâche et de la variabilité. Pour de la classification simple, 200 à 500 images par classe suffisent avec du transfer learning. Pour de la détection d'objets (YOLO, Faster R-CNN), comptez 1 000 à 5 000 images annotées. Pour de la segmentation fine, le volume monte. Mais la qualité et la représentativité du dataset comptent plus que le volume brut — 500 images bien annotées qui couvrent les cas terrain battent 10 000 images de banque d'images.

Le cloud (GPU A100/T4 sur AWS ou GCP) convient quand vous avez une connectivité fiable et que la latence de quelques centaines de millisecondes est acceptable — traitement de documents, analyse batch de photos. L'edge (NVIDIA Jetson, Intel NCS) est nécessaire quand le modèle doit tourner sur site sans internet, en temps réel strict (< 50 ms) ou quand les images ne peuvent pas quitter le site pour des raisons de confidentialité. Nous optimisons le modèle pour la cible : quantization INT8, TensorRT, export ONNX.

Le drift visuel, c'est quand les conditions terrain changent par rapport au dataset d'entraînement : éclairage saisonnier, usure des caméras, nouvelles variantes de produits. Nous mettons en place un monitoring de la distribution des scores de confiance et des prédictions. Quand le drift est détecté, on collecte automatiquement les cas difficiles (hard examples mining), on les annote et on lance un réentraînement incrémental — sans repartir de zéro.

Sur de la détection d'objets en conditions contrôlées (industrie, ligne de production), nous atteignons régulièrement 95 à 99 % de mAP. Sur de l'OCR structuré (factures, formulaires), le taux d'extraction dépasse 97 %. Les performances dépendent directement de la qualité du dataset, de la variabilité des conditions et de la définition claire des classes. Nous définissons les métriques cibles (précision, recall, F1) avec vous dès le cadrage et les mesurons sur un test set représentatif du terrain.

Un POC avec dataset existant et fine-tuning démarre à 25 000 € (annotation + entraînement + validation terrain). Une solution complète en production (pipeline d'annotation, modèle optimisé, API d'inférence, monitoring, intégration métier) se situe entre 60 000 et 180 000 € selon la complexité. Les coûts GPU récurrents (entraînement + inférence) varient de 200 à 2 000 €/mois selon le volume — ou zéro si le modèle tourne sur l'edge.

Vos images contiennent de la valeur inexploitée ?

30 minutes pour évaluer la faisabilité — gratuit, sans engagement.

Réserver un appel découverteAppel de 30 min → Audit faisabilité gratuit → POC sous 4 semaines