Agence Systèmes Prédictifs

Vous prenez encore vos décisions au feeling ?

On met du ML derrière chaque arbitrage

Prévisions dans un tableur, churn détecté trop tard, stocks qui explosent ou ruptures en série ? Nous déployons des modèles de machine learning en production — scoring, forecasting, détection d'anomalies — avec feature store, monitoring du drift et explicabilité native.

Ils nous font confiance — 250+ projets livrés

Nos technologies Systèmes Prédictifs

scikit-learn et XGBoost pour le tabulaire, PyTorch pour le deep learning et les séries temporelles, MLflow pour le tracking d'expériences, Airflow pour l'orchestration des pipelines d'entraînement — le tout déployé sur AWS ou GCP avec monitoring natif du drift.

Python

Python scikit-learn

scikit-learn XGBoost

XGBoost LightGBM

LightGBM PyTorch

PyTorch TensorFlow

TensorFlow Hugging Face

Hugging Face MLflow

MLflow Airflow

Airflow AWS

AWS Google Cloud

Google Cloud FastAPI

FastAPI Docker

Docker+20 technologies ML & prédictif maîtrisées

Nos cas clients en systèmes prédictifs

Voir tous les cas clients ›

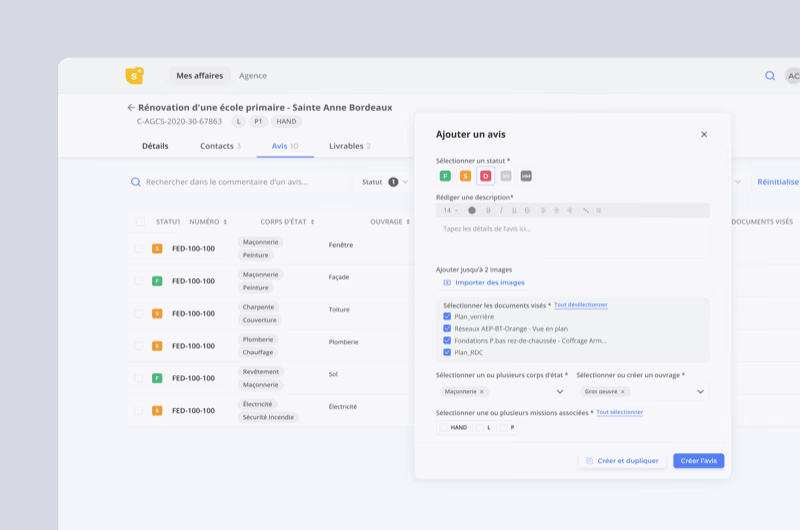

BTP Consultants

Automatisation intelligente des processus métier grâce au machine learning — classification automatique, priorisation prédictive et réduction de 95 % des coûts d'exploitation.

Voir le cas client ›

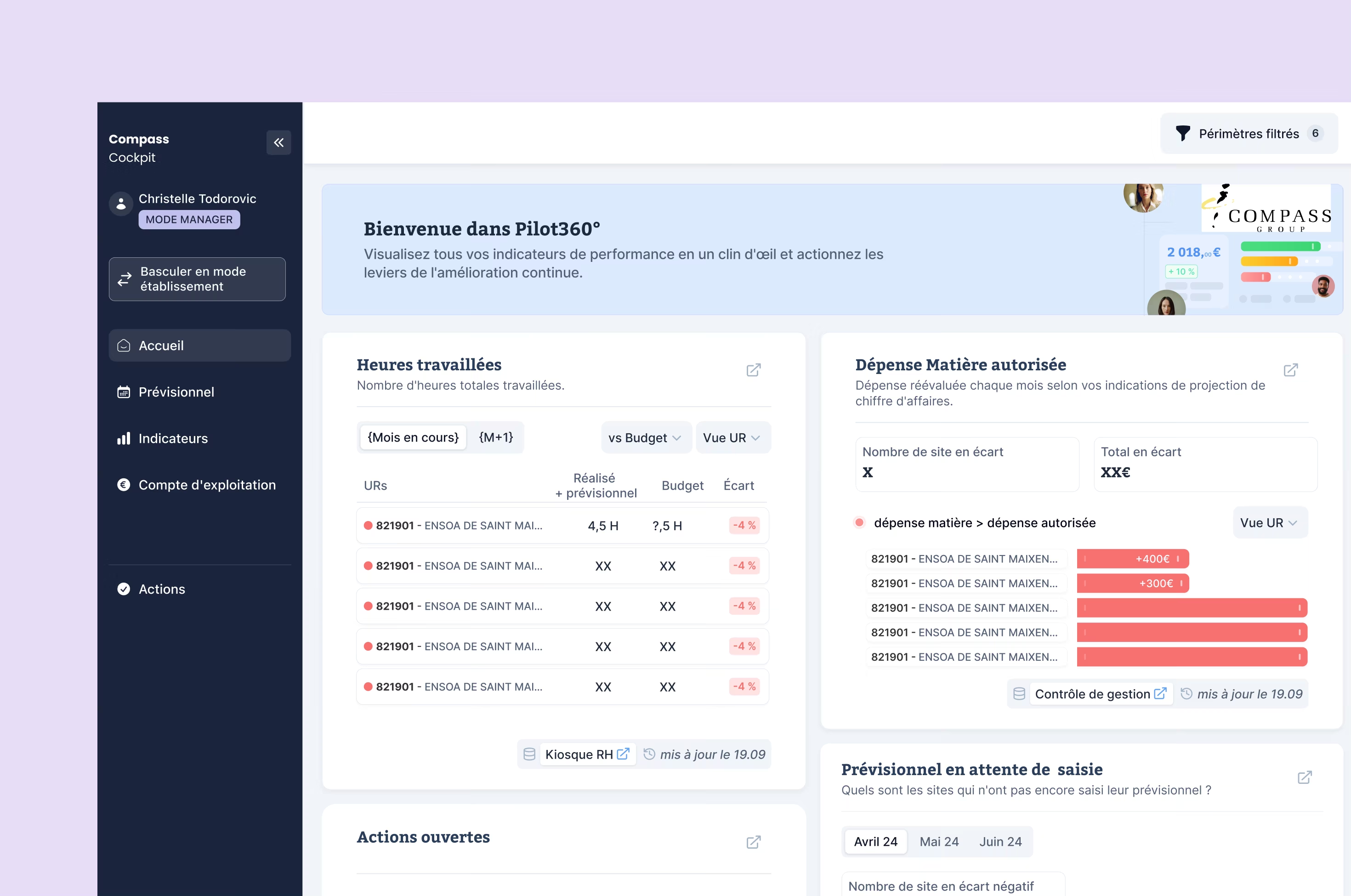

Compass Group

Modèles prédictifs sur les données opérationnelles de 3 000 établissements pour un leader mondial de la restauration collective — aide à la décision data-driven à grande échelle.

Voir le cas client ›96% de nos clients continuent avec nous

“Ils ont eu énormément d’impact sur le traitement de la data.”

Julien GOUPIT, Directeur Innovation

Des modèles qui décident, pas des rapports qui constatent

La plupart des projets ML échouent non pas parce que le modèle est mauvais, mais parce qu'il n'arrive jamais en production. Feature engineering artisanal, pas de pipeline de réentraînement, aucune explication des prédictions.

Nos ingénieurs ML construisent des systèmes prédictifs industriels : feature store versionné, pipeline d'entraînement reproductible, champion/challenger en production, monitoring du concept drift et explicabilité SHAP pour que vos métiers comprennent et fassent confiance aux prédictions.

Discutons de votre projet prédictif →Notre approche prédictive en 5 phases

Cadrage & Analyse des données

Définition du problème ML (classification, régression, anomaly detection), analyse de la qualité et du volume des données disponibles, choix de la métrique cible et estimation du lift minimum viable.

1 à 2 semainesFeature Engineering & Baseline

Extraction et transformation des features prédictives, mise en place du feature store, entraînement d'une baseline (heuristique ou modèle simple) pour fixer le seuil de performance à battre.

2 à 3 semainesModélisation & Optimisation

Entraînement et comparaison de plusieurs algorithmes, hyperparameter tuning (Optuna), gestion du class imbalance, cross-validation rigoureuse et analyse d'explicabilité (SHAP).

3 à 6 semainesMise en production & Intégration

Déploiement du modèle en API temps réel ou batch scoring, intégration dans vos outils métier (CRM, ERP, BI), champion/challenger et A/B testing pour valider l'impact réel.

2 à 3 semainesMonitoring & Amélioration continue

Surveillance du concept drift et du data drift, collecte des outcomes réels, réentraînement automatique planifié, amélioration continue des features et ajout de nouveaux cas d'usage prédictifs.

Les problèmes prédictifs concrets que nous résolvons

Vous reconnaissez ces situations ? Ce sont les cas les plus fréquents sur lesquels interviennent nos ingénieurs ML — avec des modèles en production, pas en notebook.

Vous détectez le churn quand le client est déjà parti

analyse rétrospective, pas d'alerte proactive, aucun scoring en temps réel ? Nous déployons un modèle de scoring churn (XGBoost, LightGBM) qui identifie les clients à risque 30 à 90 jours avant le départ, avec les features explicatives (SHAP) pour que vos équipes sachent quelle action mener.

Vos prévisions de demande sont dans un Excel

moyennes mobiles manuelles, pas de saisonnalité modélisée, prévisions par "intuition" ? Nous mettons en place du forecasting industriel (Prophet, Temporal Fusion Transformers, ARIMA) avec intégration des variables exogènes (météo, events, promotions) et réentraînement automatique hebdomadaire.

Vos équipements tombent en panne sans prévenir

maintenance calendaire coûteuse, aucune analyse des signaux faibles (vibration, température, courant) ? Nous construisons des modèles de maintenance prédictive qui analysent les données capteurs en temps réel et prédisent la défaillance avant qu'elle ne survienne — pour passer du curatif au préventif.

Les anomalies sont découvertes par hasard

fraude, comportement anormal, dérive de process détectés trop tard ou pas du tout ? Nous déployons de la détection d'anomalies (Isolation Forest, autoencoders) sur vos flux de données — transactions, logs, capteurs — avec alerting contextuel et scoring de sévérité pour prioriser l'investigation.

Vivez enfin une expérience client 5✦ sans risque et garantie

La croissance fulgurante d’une agence de développement web & mobile autofinancée

Voir la parution ›

Interview de Cyrille ADAM, Co-fondateur de Yield Studio, sur le développement de l’agence

Voir la parution ›

Si l’App Store a trop de concurrents, les utilisateurs risquent de se perdre

Voir la parution ›

Développement logiciel : les entreprises sont à la ramasse et ça coûte (très) cher

Voir la parution ›

Le pari réussi des développeurs séniors à l’ère de l’IA

Voir la parution ›

L’IA contraint les équipes tech à se réorganiser, et c’est une opportunité

Voir la parution ›Découvrez nos articles sur la thématique IA & Data

Voir tous nos articles ›Nos expertises en Systèmes Prédictifs

Cadrage & Feature Engineering — les données avant le modèle

Cadrage ML — définition du problème supervisé ou non-supervisé, choix de la métrique cible (F1, AUC-ROC, RMSE) alignée sur l'impact métier réel, analyse de la baseline et du lift minimum viable. Feature engineering — extraction, transformation et sélection des variables prédictives à partir de vos données brutes. Feature store — centralisation des features versionnées et réutilisables (Feast, Tecton) pour éviter le feature engineering artisanal et garantir la cohérence entre entraînement et inférence.

Modélisation & Industrialisation — du notebook à la production

Choix d'algorithme — gradient boosting (XGBoost, LightGBM) pour le tabulaire, réseaux de neurones pour les séries temporelles, Isolation Forest pour l'anomaly detection. Pas de deep learning quand un arbre de décision suffit. Pipeline MLOps — entraînement reproductible (MLflow), hyperparameter tuning automatisé (Optuna), champion/challenger pour basculer en production sans risque, rollback automatique si les métriques dérivent. Explicabilité — SHAP values et feature importance pour chaque prédiction, pas seulement au niveau du modèle global. Vos métiers doivent comprendre pourquoi le modèle prédit ce qu'il prédit.

Serving & Monitoring — des prédictions fiables dans le temps

Serving — API de prédiction temps réel (FastAPI + Docker) ou batch scoring planifié selon le SLA métier. Intégration directe dans vos outils (CRM, ERP, BI). Monitoring du drift — surveillance continue du concept drift (les patterns changent) et du data drift (les inputs changent) avec alerting automatique et déclenchement du réentraînement.

Boucle de feedback — collecte des outcomes réels pour mesurer la performance en production (pas seulement sur le test set), recalibration du modèle et amélioration continue des features.

Nos experts à votre service

Questions fréquentes

Le ML est justifié quand les règles métier ne suffisent plus : trop de variables en jeu, patterns non linéaires, ou volume de décisions trop important pour un traitement humain. Un scoring de churn avec 50 features se prête au ML. Un seuil d'alerte sur un KPI simple se gère avec une règle. Nous commençons toujours par une baseline simple (heuristique ou règle) et ne déployons du ML que si le lift justifie la complexité supplémentaire.

Les modèles dérivent naturellement — le concept drift (les patterns changent) et le data drift (les inputs changent) dégradent les performances. Nous mettons en place un monitoring continu : comparaison des distributions d'entrée vs entraînement, suivi des métriques de production (pas seulement du test set), alerting automatique quand la performance dévie. Le réentraînement est planifié (hebdomadaire ou mensuel) ou déclenché par le drift, avec un pipeline champion/challenger pour ne jamais déployer un modèle moins bon que le précédent.

L'explicabilité est critique pour l'adoption. Nous utilisons SHAP (SHapley Additive exPlanations) pour fournir une explication locale à chaque prédiction : pourquoi ce client a un score de churn élevé, quelles features pèsent le plus. Au niveau global, la feature importance et les partial dependence plots montrent comment le modèle se comporte. Pour les cas réglementaires (crédit, assurance), nous pouvons déployer des modèles intrinsèquement interprétables (régression logistique, arbres de décision) plutôt que des boîtes noires.

Le batch scoring (calcul planifié, par exemple chaque nuit) convient quand la prédiction n'a pas besoin d'être instantanée : scoring de churn hebdomadaire, prévision de demande quotidienne. Le temps réel (API de prédiction < 100 ms) est nécessaire quand la décision doit être prise dans l'instant : détection de fraude à la transaction, pricing dynamique, recommandation au clic. Le batch coûte 10× moins cher à opérer — nous ne déployons du temps réel que quand le métier le justifie.

Un premier modèle en production (feature engineering + entraînement + API de serving + monitoring) démarre à 30 000 €. Un système prédictif complet avec feature store, pipeline MLOps, explicabilité et intégration dans vos outils se situe entre 70 000 et 180 000 € selon la complexité. Les coûts récurrents (compute d'entraînement + inférence) varient de 100 à 1 500 €/mois selon le volume de prédictions et la fréquence de réentraînement.

Vos données prédisent l'avenir — vous les écoutez ?

30 minutes pour évaluer votre potentiel prédictif — gratuit, sans engagement.

Réserver un appel découverteAppel de 30 min → Audit data gratuit → POC sous 4 semaines