Une faille de sécurité applicative ne prévient pas. Elle se découvre en production, souvent après exploitation. Et le coût n'est jamais seulement technique : c'est de la donnée exposée, de la confiance perdue, parfois une obligation de notification CNIL sous 72 heures.

Pourtant, la majorité des vulnérabilités exploitées en 2025 sont connues depuis des années. Elles figurent dans des référentiels publics, documentés, outillés. Le problème n'est pas le manque d'information. C'est l'absence de méthode pour vérifier systématiquement ce qui tourne en production.

C'est exactement le rôle d'un audit de sécurité applicatif : analyser méthodiquement une application, couche par couche, pour identifier les failles avant qu'un attaquant ne le fasse.

Dans cet article, on détaille :

- ce qu'est un audit de sécurité applicatif (et ce qui le distingue d'un pentest ou d'un audit d'infrastructure) ;

- la méthodologie étape par étape, du cadrage à la remédiation ;

- le référentiel OWASP Top 10 2025 expliqué concrètement ;

- les outils indispensables (SAST, DAST, SCA) ;

- la fréquence recommandée et les ordres de grandeur de coûts.

Audit de sécurité applicatif : de quoi parle-t-on exactement ?

Le terme "audit de sécurité" recouvre des réalités très différentes selon le périmètre et la méthode. Avant de parler d'outils, il faut clarifier les distinctions.

Ce qu'est un audit de sécurité applicatif

Un audit de sécurité applicatif consiste à analyser le code, la configuration et le comportement d'une application pour identifier les vulnérabilités exploitables. Il couvre :

- le code source (back-end, front-end, API) ;

- les mécanismes d'authentification et de gestion des sessions ;

- la gestion des entrées utilisateur et la validation des données ;

- les dépendances tierces (librairies, frameworks) ;

- la configuration de déploiement (headers HTTP, CORS, TLS).

L'objectif n'est pas de "tout tester". C'est de couvrir méthodiquement les vecteurs d'attaque les plus courants et de produire un rapport exploitable par les équipes techniques.

Audit applicatif vs pentest : deux approches complémentaires

La confusion est fréquente, mais la différence est structurante :

- L'audit de sécurité applicatif est une analyse méthodique et exhaustive. Il s'appuie sur des référentiels (OWASP, ASVS), combine analyse statique et dynamique, et vise une couverture large.

- Le pentest (test d'intrusion) simule une attaque réelle, souvent en boîte noire ou grise. Il cherche à exploiter des failles spécifiques pour démontrer un impact concret.

Un pentest montre ce qu'un attaquant pourrait faire. Un audit montre ce que vous devez corriger. Les deux sont utiles, mais ils ne répondent pas à la même question.

Audit applicatif vs audit d'infrastructure

L'audit de sécurité d'infrastructure porte sur les couches basses : serveurs, réseau, pare-feu, configuration cloud, gestion des accès système. L'audit applicatif, lui, porte sur ce qui tourne au-dessus : le code, les API, la logique métier, les interactions utilisateur.

En pratique, les deux sont liés. Une application parfaitement codée mais déployée sur une infrastructure mal configurée reste vulnérable. Et inversement.

"Un audit applicatif sans regarder la configuration de déploiement, c'est comme vérifier les serrures d'une maison sans regarder si les fenêtres sont ouvertes. Les deux périmètres doivent se parler."

— James, Lead DevSecOps @ Yield Studio

📌 À retenir

L'audit de sécurité applicatif ne remplace ni le pentest, ni l'audit d'infrastructure. Il les complète en couvrant la couche logicielle, là où se concentrent aujourd'hui la majorité des vulnérabilités exploitées.

Méthodologie d'audit de sécurité applicatif : les 5 étapes clés

Un audit efficace ne se résume pas à lancer un scanner. C'est un processus structuré et reproductible en cinq phases.

Étape 1 — Cadrage et définition du périmètre

Avant de tester quoi que ce soit, il faut savoir quoi tester et pourquoi. Le cadrage définit :

- le périmètre technique : quelles applications, quelles API, quels environnements ;

- le contexte métier : données sensibles manipulées, contraintes réglementaires (RGPD, PCI-DSS, HDS) ;

- le niveau de profondeur : boîte blanche (accès au code source), boîte grise (accès partiel), boîte noire (aucun accès préalable) ;

- les exclusions : fonctionnalités hors périmètre, environnements de production à ne pas impacter.

Un cadrage bâclé produit un audit superficiel. C'est la phase où l'on investit le temps qui évitera de passer à côté de l'essentiel.

Étape 2 — Collecte d'informations et modélisation des menaces

L'auditeur cartographie l'application : architecture technique, flux de données, points d'entrée, mécanismes d'authentification, rôles utilisateur.

Cette phase inclut :

- l'analyse de l'architecture (monolithe, microservices, API gateway) ;

- l'identification des surfaces d'attaque (endpoints publics, formulaires, uploads, webhooks) ;

- la modélisation des menaces prioritaires selon le contexte métier.

L'objectif est de concentrer les tests sur les zones à risque réel, pas de tester uniformément chaque ligne de code.

Étape 3 — Tests techniques (SAST, DAST, SCA, tests manuels)

C'est le coeur technique de l'audit. On combine plusieurs approches :

- Analyse statique (SAST) : scan du code source pour détecter les failles sans exécuter l'application (injections SQL, XSS, secrets en dur, mauvaises pratiques cryptographiques).

- Analyse dynamique (DAST) : tests sur l'application en cours d'exécution pour identifier les vulnérabilités exploitables depuis l'extérieur.

- Analyse de composition (SCA) : vérification des dépendances tierces contre les bases de vulnérabilités connues (CVE).

- Tests manuels : vérification des failles logiques, contournement d'autorisations, escalade de privilèges — ce qu'aucun outil automatisé ne détecte correctement.

💡 Bon à savoir

Les outils automatisés détectent environ 60 à 70 % des vulnérabilités courantes. Les 30 % restants, souvent les plus critiques (failles logiques, contournement de workflows métier), nécessitent une analyse humaine experte.

Étape 4 — Analyse des résultats et scoring des vulnérabilités

Chaque vulnérabilité identifiée est évaluée selon :

- sa sévérité (score CVSS : critique, haute, moyenne, basse) ;

- son exploitabilité (complexité d'attaque, prérequis) ;

- son impact métier (données exposées, interruption de service, conformité réglementaire).

Le scoring permet de prioriser : on ne corrige pas tout en même temps. On commence par ce qui est exploitable et impactant.

Étape 5 — Rapport, plan de remédiation et accompagnement

Le rapport d'audit n'est pas un document technique illisible. C'est un outil de décision qui contient :

- un résumé exécutif pour les décideurs (CTO, DSI, RSSI) ;

- le détail technique de chaque vulnérabilité avec preuve de concept ;

- des recommandations priorisées avec effort estimé ;

- un plan de remédiation séquencé (quick wins, corrections structurelles, évolutions long terme).

Chez Yield Studio, on ne livre pas un rapport pour le laisser dormir dans un tiroir. On accompagne les équipes dans la correction, on vérifie les patchs, et on planifie le re-test.

"Le rapport d'audit ne vaut rien s'il n'est pas lu par les bonnes personnes et suivi d'actions concrètes. On structure toujours nos livrables en deux niveaux : un résumé décisionnel pour le COMEX, et un plan technique détaillé pour les équipes de développement."

— James, CTO @ Yield Studio

OWASP Top 10 2025 : la checklist de référence expliquée simplement

L'OWASP (Open Worldwide Application Security Project) publie régulièrement son Top 10 des risques de sécurité applicative les plus critiques. La version 2025 intègre de nouvelles catégories qui reflètent l'évolution des menaces. C'est le référentiel incontournable pour structurer un audit de sécurité applicatif.

A01:2025 — Broken Access Control (Contrôle d'accès défaillant)

Toujours en tête du classement. Un utilisateur accède à des données ou des fonctionnalités qui ne lui sont pas destinées.

Exemple concret : un utilisateur standard modifie l'ID dans l'URL (/api/users/42/invoices) et accède aux factures d'un autre client. L'API ne vérifie pas que l'utilisateur authentifié a le droit d'accéder à cette ressource.

Ce que l'audit vérifie : contrôles d'accès côté serveur, IDOR (Insecure Direct Object Reference), séparation des rôles, principe du moindre privilège.

A02:2025 — Security Misconfiguration (Mauvaise configuration de sécurité)

Monte de la 5e à la 2e place. Les erreurs de configuration sont omniprésentes : headers de sécurité absents, modes debug activés en production, permissions trop larges sur les buckets S3.

Exemple concret : une API Spring Boot déployée avec le profil debug actif expose les stack traces complètes, révélant la structure interne de l'application et les versions des composants.

Ce que l'audit vérifie : headers HTTP (CSP, HSTS, X-Frame-Options), configuration TLS, exposition de métadonnées, permissions cloud.

A03:2025 — Software Supply Chain Failures (Failles de la chaîne d'approvisionnement logicielle)

Nouvelle entrée en 2025. Concerne les compromissions via les dépendances, les pipelines CI/CD et les composants tiers.

Exemple concret : une dépendance npm populaire est compromise par un attaquant qui y injecte un backdoor. Toutes les applications qui la mettent à jour automatiquement sont touchées (cas réel : event-stream, ua-parser-js).

Ce que l'audit vérifie : intégrité des dépendances, lock files, signatures, sécurité des pipelines CI/CD, politique de mise à jour.

A04:2025 — Cryptographic Failures (Défaillances cryptographiques)

Données sensibles insuffisamment protégées : stockage en clair, algorithmes obsolètes, gestion défaillante des clés.

Exemple concret : des mots de passe hashés avec MD5 sans sel. En cas de fuite de base, un attaquant les déchiffre en quelques minutes avec des rainbow tables.

Ce que l'audit vérifie : algorithmes de hachage (bcrypt, Argon2), chiffrement au repos et en transit, gestion des secrets, certificats TLS.

A05:2025 — Injection

L'injection SQL reste présente, mais le périmètre s'élargit : NoSQL injection, LDAP injection, OS command injection, template injection.

Exemple concret : un champ de recherche non sanitisé permet d'injecter du code SQL (' OR 1=1 --) et de récupérer l'intégralité des données de la base.

Ce que l'audit vérifie : paramétrage des requêtes, ORM correctement utilisés, validation des entrées, Content Security Policy.

A06:2025 — Insecure Design (Conception non sécurisée)

Les failles de conception ne se corrigent pas avec un patch. Elles nécessitent de repenser l'architecture.

Exemple concret : un workflow de réinitialisation de mot de passe qui envoie un lien valable 30 jours, sans limitation du nombre de tentatives, et sans invalider les sessions existantes.

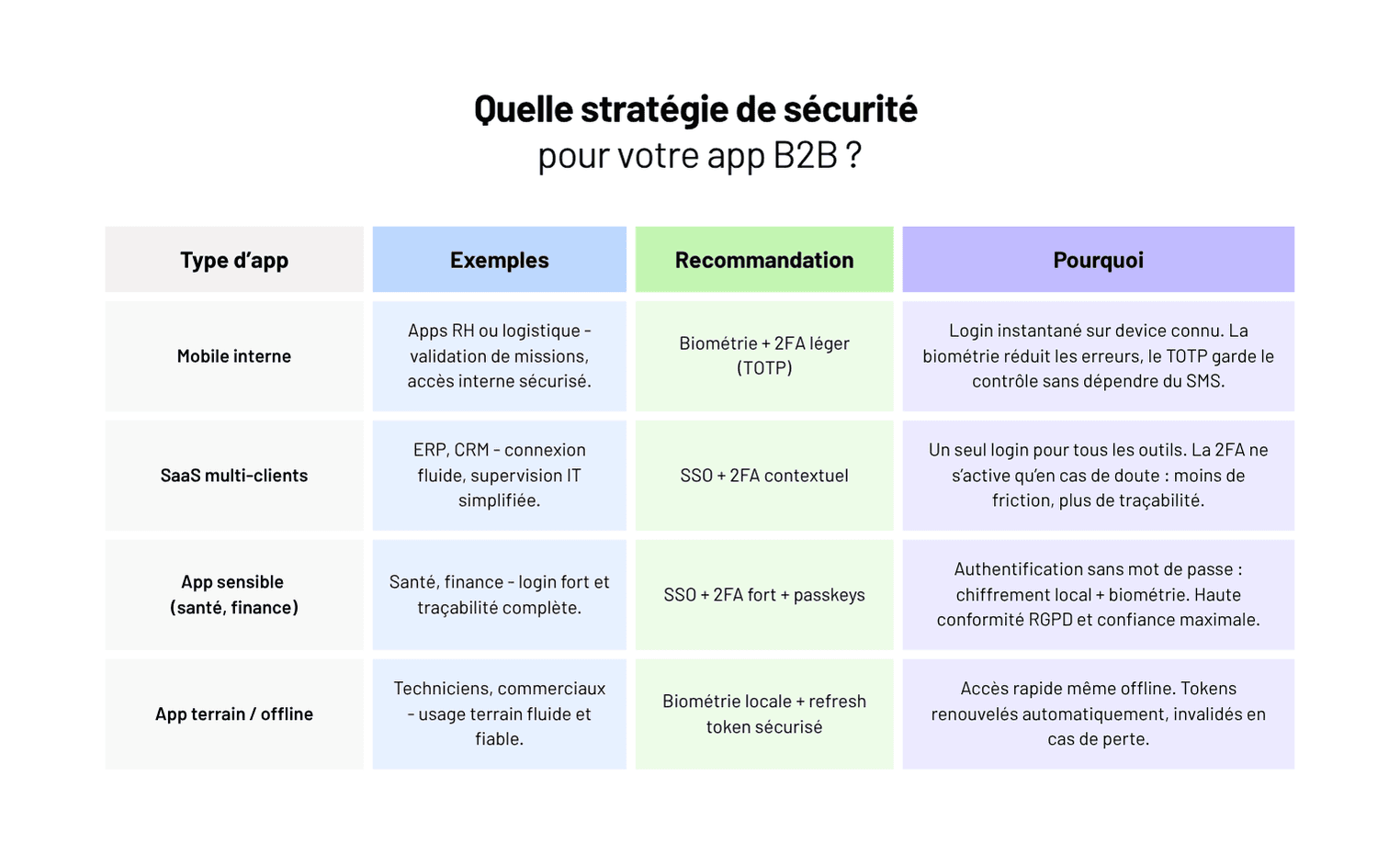

Ce que l'audit vérifie : threat modeling, séparation des responsabilités, principes de defense in depth, bonnes pratiques d'authentification (2FA, biométrie, SSO).

A07:2025 — Authentication Failures (Défaillances d'authentification)

Mécanismes d'authentification faibles ou mal implémentés : absence de protection contre le brute force, tokens prévisibles, sessions mal gérées.

Exemple concret : un formulaire de connexion qui ne limite pas les tentatives de mot de passe et ne détecte pas le credential stuffing (réutilisation de mots de passe fuités).

Ce que l'audit vérifie : politique de mots de passe, MFA, gestion des sessions, protection anti-brute force, rotation des tokens.

A08:2025 — Software and Data Integrity Failures

L'application fait confiance à des données ou du code sans vérifier leur intégrité. Exemple : une application charge des scripts depuis un CDN tiers sans Subresource Integrity (SRI). Si le CDN est compromis, le script malveillant s'exécute chez tous les utilisateurs.

A09:2025 — Security Logging and Alerting Failures

Sans logs exploitables, impossible de détecter une attaque en cours. Exemple : une exfiltration de données passe inaperçue pendant 6 mois parce que les accès API ne sont pas journalisés et aucune alerte n'est configurée.

A10:2025 — Mishandling of Exceptional Conditions

Nouvelle entrée en 2025. Exemple : une validation de paiement qui, en cas de timeout du service de vérification, valide la transaction par défaut (fail-open) au lieu de la rejeter. L'audit vérifie la gestion des erreurs, les race conditions, les timeouts et les circuit breakers.

⚠️ Point de vigilance

L'OWASP Top 10 est un point de départ, pas une couverture exhaustive. Pour les applications à haut risque (santé, finance, données personnelles sensibles), le référentiel OWASP ASVS (Application Security Verification Standard) offre une grille d'audit beaucoup plus fine avec plus de 280 points de contrôle.

Les outils indispensables pour un audit de sécurité applicatif

Un audit de sécurité applicatif rigoureux s'appuie sur trois familles d'outils complémentaires. Chacune couvre un angle différent : le code source, l'application en fonctionnement, et les dépendances tierces.

SAST — Analyse statique du code source

Le SAST (Static Application Security Testing) analyse le code sans l'exécuter pour détecter les failles structurelles dès le développement.

- Semgrep : rapide, open source, avec des règles OWASP prêtes à l'emploi. S'intègre facilement dans les pipelines CI/CD.

- SonarQube : analyse complète (sécurité, qualité, dette technique). Vue consolidée sur la santé du code, idéal pour le suivi long terme.

Détecte bien : injections SQL, XSS, secrets en dur, mauvaises pratiques cryptographiques. Rate : failles logiques, contrôle d'accès contextuel.

DAST — Analyse dynamique en conditions réelles

Le DAST (Dynamic Application Security Testing) teste l'application en cours d'exécution, comme le ferait un attaquant externe.

- OWASP ZAP : gratuit, open source. Mode automatisé et exploration manuelle. Idéal pour démarrer.

- Burp Suite : la référence professionnelle pour les tests manuels avancés et l'interception de requêtes HTTP.

Détecte bien : injections exploitables, misconfigurations serveur, headers manquants. Rate : vulnérabilités dans le code non exposé publiquement.

SCA — Analyse des dépendances et de la supply chain

Le SCA (Software Composition Analysis) vérifie que les librairies utilisées ne contiennent pas de vulnérabilités connues.

- Snyk : détection de CVE dans les dépendances avec suggestions de correction automatique. S'intègre dans l'IDE et le CI/CD.

- Dependabot (GitHub) : pull requests automatiques pour mettre à jour les dépendances vulnérables. Gratuit et natif.

Détecte bien : CVE connues, licences non conformes, dépendances obsolètes. Rate : vulnérabilités zero-day, failles dans le code propriétaire.

"On intègre systématiquement ces trois couches dans nos pipelines CI/CD. Semgrep sur chaque commit, Snyk sur chaque build, OWASP ZAP en pré-production. L'objectif n'est pas de bloquer les développeurs, mais de détecter les régressions de sécurité le plus tôt possible dans le cycle."

— James, Lead DevSecOps @ Yield Studio

💡 Bon à savoir

Aucun outil ne couvre l'ensemble des risques à lui seul. La combinaison SAST + DAST + SCA est le minimum pour un audit sérieux. Pour les applications critiques, l'analyse manuelle par un expert reste indispensable.

Fréquence et coûts d'un audit de sécurité applicatif

La question "à quelle fréquence faut-il auditer ?" revient systématiquement. La réponse dépend du contexte, mais il existe des repères clairs.

Fréquence recommandée selon le contexte

Audit complet (SAST + DAST + SCA + tests manuels) :

- Applications critiques (santé, finance, données personnelles sensibles) : tous les 6 mois minimum, et après chaque évolution majeure.

- Applications métier classiques (SaaS B2B, logiciel interne, e-commerce) : une fois par an, et à chaque refonte significative.

- Applications à faible exposition (outils internes sans données sensibles) : tous les 18 à 24 mois, avec un scan automatisé continu.

Scans automatisés continus (CI/CD) :

- SAST : à chaque commit ou merge request.

- SCA : à chaque build, avec alerting sur les nouvelles CVE.

- DAST : hebdomadaire ou avant chaque mise en production.

Ordres de grandeur des coûts

Les coûts varient selon le périmètre, la complexité de l'application et le niveau de profondeur souhaité :

- Audit applicatif focalisé (une application, périmètre limité) : 5 000 à 15 000 EUR.

- Audit complet (application complexe, API multiples, tests manuels approfondis) : 15 000 à 40 000 EUR.

- Programme de sécurité continu (audits réguliers, outillage CI/CD, accompagnement remédiation) : à partir de 2 000 EUR/mois.

Ces montants sont à mettre en perspective avec le coût d'une fuite de données : en moyenne 4,45 millions de dollars selon le rapport IBM Cost of a Data Breach 2024, sans compter les sanctions RGPD (jusqu'à 4 % du chiffre d'affaires mondial).

📌 À retenir

Le coût d'un audit est toujours inférieur au coût d'un incident. La vraie question n'est pas "est-ce que c'est rentable ?", mais "est-ce qu'on peut se permettre de ne pas le faire ?".

Au-delà de l'audit ponctuel : intégrer la sécurité dans le cycle de développement

Un audit ponctuel est nécessaire, mais insuffisant. L'approche cybersécurité que nous pratiquons chez Yield Studio repose sur le principe du shift-left : déplacer les contrôles de sécurité le plus tôt possible dans le cycle de développement.

Concrètement, cela signifie :

- SAST dans l'IDE et sur chaque merge request (Semgrep) ;

- SCA sur chaque build avec alerting automatique (Snyk) ;

- DAST hebdomadaire ou avant chaque mise en production (ZAP) ;

- threat modeling dès la conception pour les fonctionnalités sensibles.

Une faille détectée en développement coûte 10 fois moins à corriger qu'en production (NIST, IBM). Intégrer la sécurité dans le workflow quotidien ne ralentit pas la delivery : cela évite les corrections d'urgence qui, elles, coûtent très cher.

"Le DevSecOps n'est pas un rôle. C'est une pratique d'équipe. Quand chaque développeur sait lire un rapport de scan et comprendre les enjeux d'une CVE critique, la sécurité cesse d'être un sujet à part. Elle devient un réflexe."

— James, Lead DevSecOps @ Yield Studio

⚠️ Point de vigilance

Les cinq erreurs les plus fréquentes que nous observons : auditer une fois et ne jamais recommencer ; se reposer uniquement sur les outils automatisés (qui ratent les failles logiques) ; produire un rapport sans plan de remédiation priorisé ; ignorer les dépendances tierces (80 % du code d'une application moderne) ; traiter la sécurité comme un sujet séparé du développement. Si votre dernier audit date de plus d'un an et que votre application a évolué significativement depuis, vos vulnérabilités actuelles sont probablement différentes de celles identifiées à l'époque.

Conclusion — Un audit de sécurité applicatif n'est pas un luxe, c'est un prérequis

Les failles applicatives ne sont pas des risques théoriques. Elles sont exploitées quotidiennement, sur des applications de toutes tailles, dans tous les secteurs. Le référentiel OWASP Top 10 2025 le confirme : les vulnérabilités les plus critiques restent liées à des erreurs connues, documentées et évitables.

Un audit de sécurité applicatif rigoureux, adossé à une méthodologie claire et aux bons outils, permet de :

- identifier les failles avant qu'elles ne soient exploitées ;

- prioriser les corrections en fonction du risque réel ;

- construire une posture de sécurité durable, pas juste un rapport ponctuel.

Chez Yield Studio, nous accompagnons les entreprises sur l'ensemble du spectre : de l'audit IT complet à l'intégration de la sécurité dans les pipelines de développement, en passant par la remédiation et le suivi dans le temps.

La sécurité applicative n'est pas un projet ponctuel. C'est une pratique continue.

👉 Vous souhaitez auditer la sécurité de vos applications ou structurer une démarche DevSecOps ? Parlons-en. Nos experts vous aident à identifier les vrais risques et à construire un plan d'action concret, adapté à votre contexte technique et métier.